Nos bastidores: O nosso laboratório de ML

O que está dentro

No nosso último artigo, mergulhamos no excitante mundo da tecnologia de sincronização labial daRask AI, com a orientação do Diretor de Aprendizagem Automática da empresa , Dima Vypirailenko. Levamo-lo aos bastidores do Brask ML Lab, um centro de excelência para a tecnologia, onde vemos em primeira mão como esta inovadora ferramenta de IA está a fazer ondas na criação e distribuição de conteúdos. A nossa equipa inclui engenheiros de ML e artistas sintéticos de VFX de classe mundial que não estão apenas a adaptar-se ao futuro; estamos a criá-lo.

Junte-se a nós para descobrir como esta tecnologia está a transformar a indústria criativa, reduzindo custos e ajudando os criadores a chegar a audiências em todo o mundo.

O que é a tecnologia Lip-Sync?

Um dos principais desafios na localização de vídeos é o movimento não natural dos lábios. A tecnologia de sincronização dos lábios foi concebida para ajudar a sincronizar eficazmente os movimentos dos lábios com as faixas de áudio multilingues.

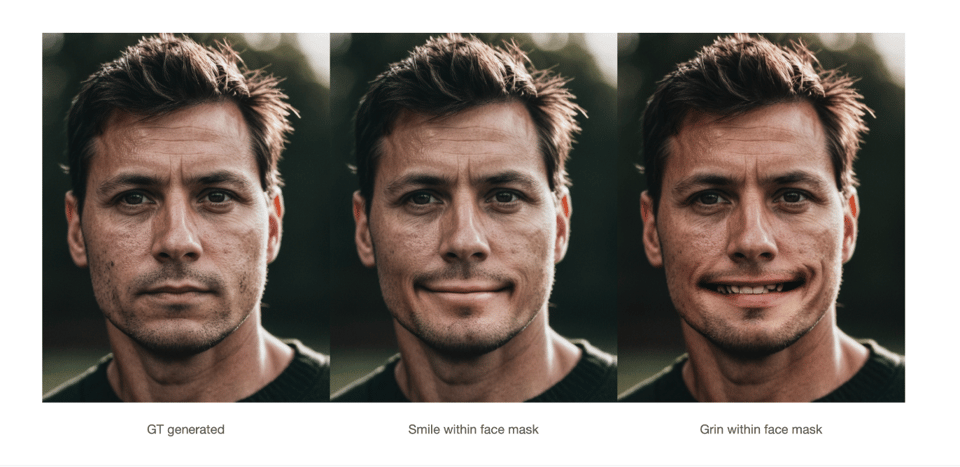

Como aprendemos no nosso último artigo, a técnica de sincronização labial é muito mais complexa do que apenas acertar o tempo - é necessário acertar os movimentos da boca. Todas as palavras pronunciadas terão um efeito no rosto do orador, como o "O", que obviamente criará uma forma oval da boca, pelo que não será um "M", acrescentando muito mais complexidade ao processo de dobragem.

Apresentamos o novo modelo Lip-sync com melhor qualidade!

A nossa equipa de ML decidiu melhorar o modelo de sincronização labial existente. Qual foi a razão por detrás desta decisão e o que há de novo nesta versão em comparação com a versão beta?

Foram envidados esforços significativos para melhorar o modelo, incluindo:

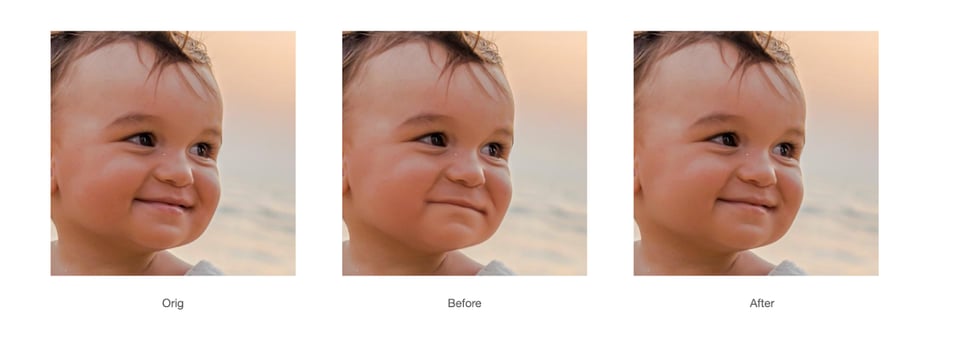

- Precisão melhorada: Aperfeiçoámos os algoritmos de IA para melhor analisar e fazer corresponder os detalhes fonéticos da linguagem falada, conduzindo a movimentos labiais mais precisos que estão estreitamente sincronizados com o áudio em vários idiomas.

- Naturalidade melhorada: Ao integrar dados de captura de movimento mais avançados e ao aperfeiçoar as nossas técnicas de aprendizagem automática, melhorámos significativamente a naturalidade dos movimentos dos lábios, fazendo com que o discurso das personagens pareça mais fluido e realista.

- Aumento davelocidade e da eficiência: Otimizamos o modelo para processar vídeos mais rapidamente sem sacrificar a qualidade, facilitando tempos de resposta mais rápidos para projetos que exigem localização em grande escala.

- Incorporação do feedback dos utilizadores: Recolhemos ativamente o feedback dos utilizadores da versão beta e incorporámos as suas ideias no processo de desenvolvimento para resolver problemas específicos e aumentar a satisfação geral do utilizador.

Como é que o nosso modelo de IA sincroniza exatamente os movimentos labiais com o áudio traduzido?

Dima: "O nosso modelo de IA funciona combinando as informações do áudio traduzido com as informações sobre o rosto da pessoa no enquadramento e, em seguida, funde-as no resultado final. Esta integração garante que os movimentos dos lábios são sincronizados com precisão com o discurso traduzido, proporcionando uma experiência de visualização perfeita".

Que características únicas tornam o Premium Lip-Sync ideal para conteúdos de alta qualidade?

Dima: "O Premium Lip-sync foi especificamente concebido para lidar com conteúdos de alta qualidade através das suas características únicas, como a capacidade para vários altifalantes e o suporte de alta resolução. Pode processar vídeos com uma resolução até 2K, assegurando que a qualidade visual é mantida sem compromissos. Além disso, a funcionalidade de vários altifalantes permite uma sincronização labial precisa entre diferentes altifalantes no mesmo vídeo, tornando-o altamente eficaz para produções complexas que envolvam várias personagens ou altifalantes. Estas características fazem do Premium Lipsync uma escolha de topo para os criadores que pretendem obter conteúdos de nível profissional".

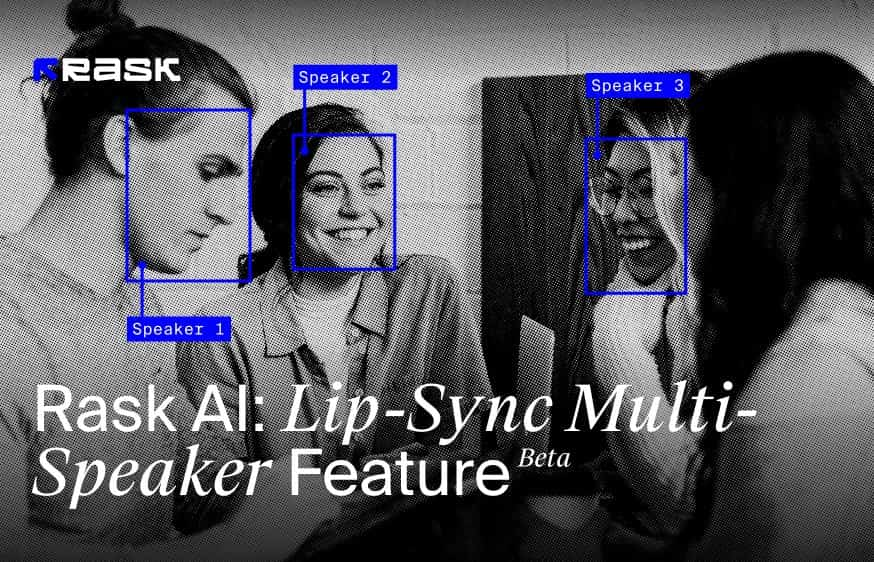

E o que é uma funcionalidade de altifalantes múltiplos com sincronização labial?

A funcionalidade Multi-Speaker Lip-Sync foi concebida para sincronizar com precisão os movimentos labiais com o áudio falado em vídeos com várias pessoas. Esta tecnologia avançada identifica e diferencia vários rostos numa única imagem, assegurando que os movimentos labiais de cada indivíduo são corretamente animados de acordo com as suas palavras faladas.

Como funciona a sincronização labial com vários altifalantes:

- Reconhecimento de rosto no quadro: A funcionalidade reconhece inicialmente todos os rostos presentes no fotograma do vídeo, independentemente do número. É capaz de identificar cada indivíduo, o que é crucial para uma sincronização labial precisa.

- Correspondência de áudio: Durante a reprodução do vídeo, a tecnologia alinha a faixa de áudio especificamente com a pessoa que está a falar. Este processo de correspondência precisa garante que a voz e os movimentos dos lábios estão em sincronia.

- Sincronização dos movimentos labiais: Assim que o indivíduo que fala é identificado, a funcionalidade de sincronização labial redesenha os movimentos labiais apenas para a pessoa que fala. Os indivíduos que não falam no enquadramento não terão os seus movimentos labiais alterados, mantendo o seu estado natural ao longo do vídeo. Esta sincronização aplica-se exclusivamente ao orador ativo, tornando-a eficaz mesmo na presença de vozes fora do ecrã ou de vários rostos na cena.

- Manuseamento deimagens estáticas de lábios: Curiosamente, esta tecnologia também é suficientemente sofisticada para redesenhar os movimentos dos lábios em imagens estáticas de lábios, caso estas apareçam no enquadramento do vídeo, demonstrando a sua capacidade versátil.

Esta funcionalidade de sincronização labial com vários oradores aumenta o realismo e o envolvimento do espetador em cenas com vários oradores ou cenários de vídeo complexos, garantindo que apenas os lábios dos indivíduos que falam se movem de acordo com o áudio. Esta abordagem específica ajuda a manter o foco no orador ativo e preserva a dinâmica natural das interacções de grupo nos vídeos.

A partir de apenas um vídeo, em qualquer idioma, pode criar centenas de vídeos personalizados com várias ofertas em vários idiomas. Esta versatilidade revoluciona a forma como os profissionais de marketing podem interagir com públicos diversificados e globais, aumentando o impacto e o alcance do conteúdo promocional.

Como é que se equilibra a qualidade e a velocidade de processamento no novo Premium Lip-sync?

Dima: "Equilibrar alta qualidade com velocidade de processamento rápida no Premium Lipsync é um desafio, mas fizemos progressos significativos na otimização da inferência do nosso modelo. Esta otimização permite-nos obter a melhor qualidade possível a uma velocidade decente".

Há alguma imperfeição ou surpresa interessante que tenha encontrado durante o treino do modelo?

Para além disso, trabalhar com oclusões à volta da área da boca tem-se revelado bastante difícil. Estes elementos requerem uma cuidadosa atenção ao pormenor e uma modelação sofisticada para conseguir uma representação realista e precisa na nossa tecnologia de sincronização labial.

Como é que a equipa do ML garante a privacidade e a proteção dos dados do utilizador ao processar materiais de vídeo?

Dima: A nossa equipa de ML leva muito a sério a privacidade e a proteção dos dados dos utilizadores. Para o modelo Lipsync, não utilizamos os dados dos clientes para o treino, eliminando assim qualquer risco de roubo de identidade. Apenas nos baseamos em dados de código aberto que vêm com licenças apropriadas para treinar o nosso modelo. Além disso, o modelo funciona como uma instância separada para cada utilizador, garantindo que o vídeo final é entregue apenas ao utilizador específico e evitando qualquer confusão de dados.

Na nossa essência, estamos empenhados em capacitar os criadores, assegurando a utilização responsável da IA na criação de conteúdos, com um enfoque nos direitos legais e na transparência ética. Garantimos que os seus vídeos, fotografias, vozes e semelhanças nunca serão utilizados sem autorização explícita, assegurando a proteção dos seus dados pessoais e activos criativos.

Temos orgulho de sermos membros da Coalition for Content Provenance and Authenticity (C2PA) e da The Content Authenticity Initiative, refletindo nossa dedicação à integridade e autenticidade do conteúdo na era digital. Além disso, nossa fundadora e CEO, Maria Chmir, é reconhecida no diretório Women in AI Ethics™, destacando nossa liderança em práticas éticas de IA.

Quais são as perspectivas futuras para o desenvolvimento da tecnologia de sincronização labial? Existem áreas específicas que o entusiasmam particularmente?

Dima: Acreditamos que a nossa tecnologia de sincronização labial pode servir de base para o desenvolvimento de avatares digitais. Imaginamos um futuro em que qualquer pessoa pode criar e localizar conteúdos sem incorrer em custos de produção de vídeo.

A curto prazo, nos próximos dois meses, estamos empenhados em melhorar o desempenho e a qualidade do nosso modelo. O nosso objetivo é garantir um funcionamento suave em vídeos 4K e melhorar a funcionalidade com vídeos traduzidos para línguas asiáticas. Estes avanços são cruciais, uma vez que pretendemos alargar a acessibilidade e a usabilidade da nossa tecnologia, abrindo caminho a aplicações inovadoras na criação de conteúdos digitais. Experimente a nossa funcionalidade melhorada de sincronização labial e envie-nos os seus comentários sobre esta funcionalidade.

FAQ

A sincronização labial está disponível nos planos Creator Pro, Archive Pro, Business e Enterprise.

Um minuto de sincronização labial gerado equivale a um minuto deduzido do seu saldo total de minutos.

Os minutos de sincronização labial são deduzidos da mesma forma que na dobragem dos seus vídeos.

A sincronização labial é cobrada separadamente da dobragem. Por exemplo, para traduzir e sincronizar labialmente um vídeo de 1 minuto para 1 idioma, são necessários 2 minutos.

Antes de gerar sincronização labial, poderá testar 1 minuto gratuito para avaliar a qualidade da tecnologia.

A velocidade de geração da sincronização labial depende do número de oradores no vídeo, da duração, da qualidade e do tamanho do vídeo.

Por exemplo, eis a taxa aproximada de geração de sincronização labial para diferentes vídeos:

Vídeos com um orador

- Vídeo de 4 minutos 1080p ≈ 29 minutos

- 10 minutos 1080p ≈ 2 horas 10 minutos

- 10 minutos de vídeo 4K ≈ 8 horas

Vídeos com 3 oradores:

- 10 minutos 1080p ≈ 5 horas e 20 minutos

- Carregue o seu vídeo através da ligação do YouTube, do Google Drive ou carregue diretamente o ficheiro a partir do seu dispositivo. Escolha o idioma de destino e clique no botão traduzir.

- Adicione uma narração ao seu vídeo em Rask AI através do botão "Dub video".

- Para verificar se o seu vídeo é compatível com a sincronização labial, clique no botão "Verificação da sincronização labial".

- Se for compatível, toque no botão Sincronização labial.

- Em seguida, seleccione o número de rostos que pretende no vídeo - "1" ou "2+" e, depois, toque em "Start Lip-sync" (Iniciar sincronização labial). Só para avisar, isto diz respeito ao número de rostos, não de altifalantes.

Rask%20Lens%20A%20Recap%204.webp)